GNNでできること:グラフニューラルネットワークの概要と実用例

グラフニューラルネットワーク(Graph Neural Networks、GNN)とは、グラフ構造データを扱うための深層学習技術です。

グラフ構造は、私たちの生活のありとあらゆる所に存在しています。例えばSNSでの繋がり、化学構造、交通ネットワークなど多岐にわたる分野で見られるため、GNNの応用範囲は非常に広いです!

この記事では主に、GNNの基本概念、タスクの種類、代表的なGNNモデル、実用例について解説します!

- GNNって何?

- GNNで何ができるか知りたい

という方におすすめです。

GNNとは

概略

GNNは、グラフ構造データを直接扱うことができるニューラルネットワークの一種です。従来のニューラルネットワークや畳み込みニューラルネットワーク(CNN)が、主に画像やテキストといったデータを対象としているのに対し、GNNはグラフ構造を学習するための機械学習モデルです。

歴史

初期の研究 (2005年以前)

2005年にFranco Scarselliらによって発表された論文「The Graph Neural Network Model」[1]で、GNNの基本的なフレームワークが初めて提案されました。具体的には、グラフ上のノードが隣接ノードから情報を集約することで、ノードやグラフ全体の特性を学習するというGNNにおける基本的なアイデアが発表されました。

深層学習の隆盛とGNN (2010年代初頭〜中頃)

2010年代に入ると、深層学習技術の進展により、画像認識、自然言語処理などの分野で顕著な成果が報告されました。同時期に、深層学習をグラフデータに応用する研究が本格化し、GNNの研究も加速しました。特に、畳み込みニューラルネットワーク(CNN)の概念をグラフデータに適用するGraph Convolutional Network(GCN)[2]などの新しいモデルが提案されました。

GNNの多様化と応用 (2010年代後半〜現在)

GCNをはじめとするモデルの提案以降、GNNは急速に発展しました。GraphSAGEやGraph Attention Network(GAT)などのモデルが提案され、ノードやエッジの特性をより精密に学習できるようになりました。またこれらの発展によって、GNNはソーシャルネットワーク分析、薬剤発見、推薦システム、物理シミュレーションなど、多岐にわたる分野で応用されるようになりました。

GNNでできること

GNNが具体的に扱うことのできるグラフの例、タスクを紹介します。

GNNで扱えるグラフの例

GNNではグラフ構造のデータ扱うことができます。以下に具体的に扱うことのできる入力データの例を挙げます。

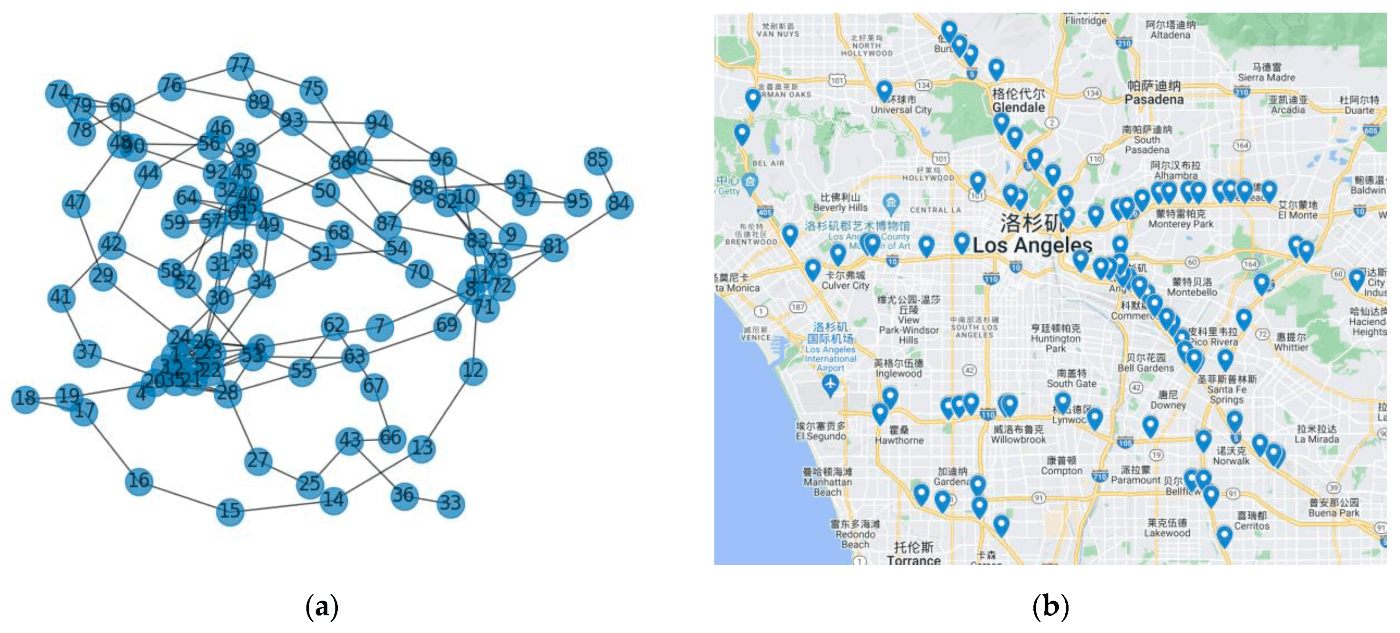

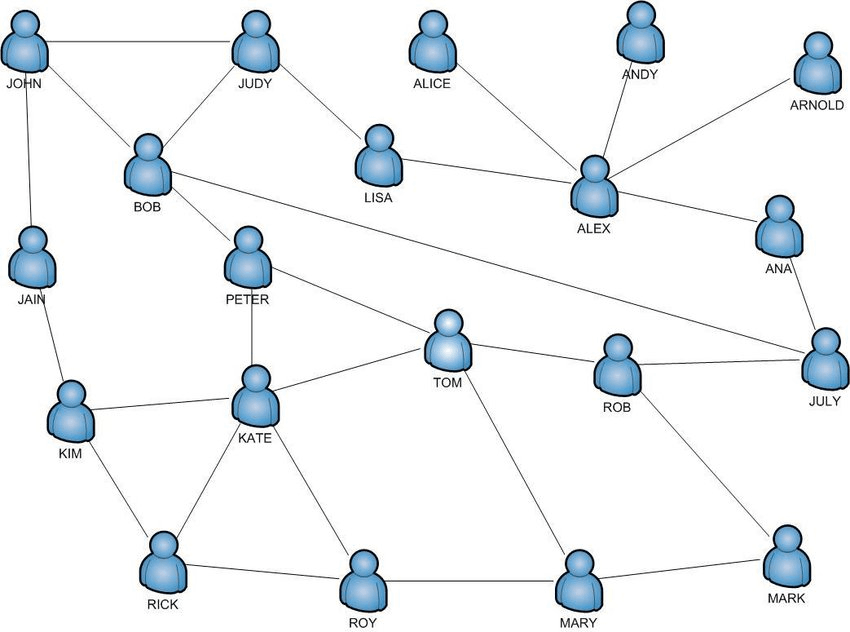

- ソーシャルネットワーク:SNS上でのフォロー関係などをエッジとみなしたグラフ構造となります。このグラフに対するユーザー間で新たに発生するであろう繋がりの予測(リンク予測)や、あるコミュニティに所属するユーザーらの検出(コミュニティ検出)をすることなどができます。

(画像引用元:Filipowski, T., Kazienko, P., Brodka, P. and Kajdanowicz, T., 2012, Figure 2 [3])

(画像引用元:Hu, Z., Shao, F. and Sun, R., 2022, Figure 1 [4])

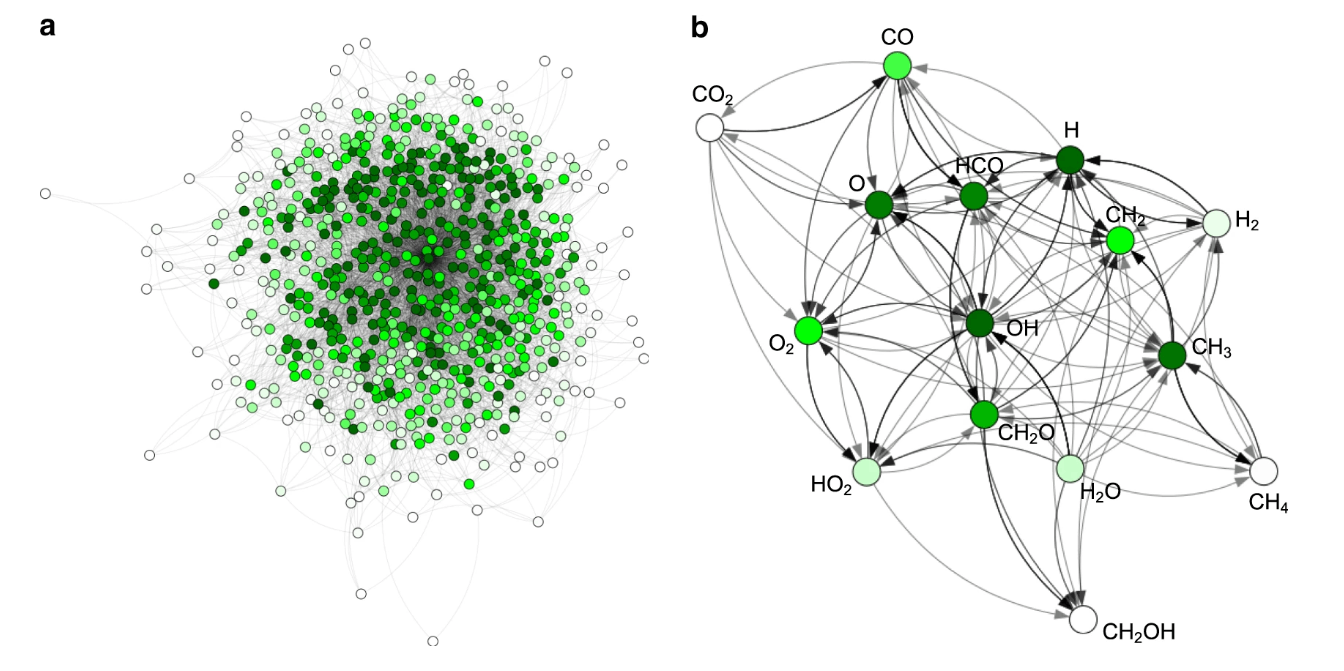

(画像引用元:Stocker, S., Csányi, G., Reuter, K. and Margraf, J.T., 2020, Fig. 1 [5])

以上の例のように、GNNはネットワーク構造を持つものであれば種々様々な予測を行うことが可能です。次の章では、GNNが解くタスクを3つに大別し解説します。

GNNで解けるタスク

GNNで解くことのできるタスクは以下の大きく3つに分けられます。

ノード予測

ノード予測は、グラフ構造を持つデータにおいて、各ノード(頂点)の特性やラベルを予測するタスクです。このタスクは、ソーシャルネットワーク、化学分子構造、交通ネットワークなど、さまざまな分野で重要な役割を果たしています。例えば、ソーシャルネットワークにて、ある人が特定の属性を持つか(ある趣味に興味を持っているか)や化学構造においてそのノードの分子が何であるかを予測することなどができます。

エッジ予測

エッジ予測は、グラフ構造を持つデータにおいて、ノード間に新たなエッジ(辺)が形成されるかどうかを予測するタスクです。このタスクも、ソーシャルネットワーク、バイオインフォマティクス、交通ネットワークなど、さまざまな分野で重要な役割を果たしています。例えば、ソーシャルネットワークにて、あるユーザーが将来的にあるユーザーをフォロー関係になるかの予測や、交通ネットワークでは、新たに形成される可能性のある交通ルートを予測し、交通インフラの最適化を図ることなどができます。

グラフ全予測

グラフ全体予測は、グラフ構造を持つデータ全体の特性や構造を予測するタスクです。ノードやエッジの特性だけでなく、グラフ全体の性質や特徴を理解することが目的です。このタスクは、グラフ全体の分類、クラスタリング、生成など、さまざまな形式で行われます。例えば、ある社会ネットワークにて、そのネットワークが特定のコミュニティであるかどうかの予測や特定のトピックにどのくらい関心をもっているかの予測などを行うことができます。

代表的なGNNモデル

以下に代表的なモデルであるGraphSAGEとGATについて解説します。

GraphSAGE [6]

GraphSAGE(Graph Sample and Aggregation)は、グラフ構造を持つデータに対する半教師あり学習を可能にするグラフニューラルネットワーク(GNN)の一種です。GraphSAGEでは、ノードの局所的な近傍情報を効果的に集約し、それを元にグラフ全体の表現を学習します。このモデルは、Heterogeneousなネットワークや大規模なグラフにも適用できる高い汎用性を持ち、ノード分類、リンク予測、グラフ全体の特徴量抽出など、さまざまなタスクに応用されます。GraphSAGEの主要な特徴は、各ノードの隣接ノードの情報をサンプリングして効率的に収集し、それらを集約してノードの表現を更新する手法にあります。これにより、大規模なグラフにおいても計算効率を確保しつつ、高品質な表現を学習することが可能です。GraphSAGEは、グラフデータの解析や予測において優れた性能を発揮し、多くの実世界の問題に対する解決策として広く利用されています。

GAT [7]

GAT(Graph Attention Network)は、グラフ構造を持つデータに対する学習能力を高めるために設計されたグラフニューラルネットワーク(GNN)の一種です。GATは、各ノードの特徴を更新する際に、隣接ノードとの関係性に基づいて重み付けされた情報を利用します。これにより、ノード間の重要な関係性や構造的な特徴をより効果的に捉えることができます。GATは、ノードの特徴を更新する際に、異なる隣接ノードに対して異なる重みを割り当てることが可能であり、これによって異なるノード間の関係性を柔軟にモデリングすることができます。また、複数の注意機構を用いて複数の階層の情報を統合することで、グラフ全体の表現を学習します。GATは、その優れた表現学習能力と柔軟性により、ノード分類、リンク予測、グラフ異常検出など、さまざまなグラフ関連のタスクに応用されています。

まとめ

本記事ではGNNとは何か、GNNでできること、具体的なモデルについて解説しました。更なるGNNに関する解説は、以下の「グラフニューラルネットワーク(GNN)徹底解説!用途と仕組みからPyGでの実装まで」にて詳しく行われていますので非常におすすめです。

参考文献

[1] Scarselli, Franco, et al. “The graph neural network model.”IEEE transactions on neural networks 20.1 (2008): 61-80.

[2] Kipf, Thomas N., and Max Welling. “Semi-supervised classification with graph convolutional networks.”arXiv preprint arXiv:1609.02907(2016).

[6] Hamilton, Will, Zhitao Ying, and Jure Leskovec. “Inductive representation learning on large graphs.” Advances in neural information processing systems 30 (2017).

[7] Veličković, Petar, et al. “Graph attention networks.” arXiv preprint arXiv:1710.10903 (2017).

東京大学 前田 優樹

2024年5月28日 公開